Ein Meer aus Nebel

Dies ist ein Artikel von David Kaplan aus Zürich. Er arbeitet tagsüber als Softwareentwickler. Nachts verwandelt er sich zu einem leidenschaftlichen Fotografen, der häufig in den Schweizer Alpen anzutreffen ist. Was er dort schon alles vor die Linse bekommen hat, kann auf kplan.ch & auch in der Fotocomunity begutachtet werden.

Dies ist ein Artikel von David Kaplan aus Zürich. Er arbeitet tagsüber als Softwareentwickler. Nachts verwandelt er sich zu einem leidenschaftlichen Fotografen, der häufig in den Schweizer Alpen anzutreffen ist. Was er dort schon alles vor die Linse bekommen hat, kann auf kplan.ch & auch in der Fotocomunity begutachtet werden.Was ist der schönste Anblick, den man in der Natur sehen kann? Das warme Leuchten einer untergehenden Sonne? Die wogenden Wellen in einer idyllisch gelegenen Bucht? Die unendlichen Weiten des Universums? Oder doch die verschneiten Gipfel einer hohen Gebirgskette? Jeder mag da so seine Präferenzen haben.

Das Schönste, dem ich in meiner Laufbahn als Landschaftsfotograf schon gegenübergestanden bin, war ein von unten beleuchtetes Nebelmeer in der Nacht. Dazu oben die Sterne und im Hintergrund die Berge – also irgendwie all das, was ich zu Beginn aufgezählt habe.

~

Schon seit geraumer Zeit hatte ich den Wunsch, ein solches Nebelmeer auch fotografisch festzuhalten. Das stellte sich als schwieriger heraus, als zunächst gedacht. Nach einigen nicht ganz erfolglosen Ausflügen ist mir dann Ende letzten Jahres dieses Foto gelungen:

Ich möchte in diesem Artikel beschreiben, wie ich vorgegangen bin um dieses Foto zu Stande zu bringen.

Planung

So ein Foto ist ohne gute Planung fast unmöglich zu schiessen, darum fängt das ganze Projekt zunächst im Kopf bzw. auf Papier an. Folgende drei Punkte habe ich dabei berücksichtigt:

1. Wetter

Zunächst mal muss das Wetter stimmen. Die gängigen Wetterseiten nehme ich mal als Anhaltspunkt, aber nicht als einzige Grundlage. Denn die Wetterdienste sind oft nicht genau genug, um lokale nächtliche Nebelentstehungsgebiete vorherzusagen – oder es interessiert einfach Niemanden.

Zusätzlich schaue ich mir noch Webcams auf Bergen an und beobachte auch die Wolken / Nebelsituation am Wohnort genau. Am 29.12. war es dann so weit: meteoschweiz.ch hat Nebel vorhergesagt.

2. Standort

Den Standort musste ich natürlich sehr sorgfältig aussuchen. Es musste ein Ort sein, wo ich mit dem Auto bei winterlichen Strassenverhältnissen möglichst hoch hinaufkomme und zudem einen guten Blick in ein nicht zu dünn und nicht zu dick bewohntes Tal offenbart.

Nach langer Recherche in Google Earth bin ich dann auf das Gebiet rund um Schwyz gestossen. Die Gemeinde hat mit 14’234 Einwohnern eine ziemlich gute Grösse und auf den z.T. recht hohen Hängen rund herum gibt es viele schmale Strassen, die von den dort wohnenden Bauern wahrscheinlich regelmässig vom Schnee befreit werden. Dazu noch die malerische Bergkulisse, die natürlich auf keinen Fall fehlen darf.

3. Zeitpunkt

Ich wollte unbedingt in einer mondlosen Nacht fotografieren, da dies nicht nur das Nebelmeer sondern auch die Sterne optimal zur Geltung bringt. Da der Mond erst am 30.12. um 2 Uhr früh aufging, konnte ich am Mittwochabend, dem 29., den Ausflug durchführen.

Generell muss ich meine Ausflüge zeitlich so planen, das Wetter und Mondkonstellation passen und kann nicht einfach dann losziehen, wenn ich mal wieder Lust habe. Das heisst auch, dass ich hin und wieder mal bei der Arbeit frei nehmen muss.

Durchführung

– Equipment

Nicht lange nachdem ich mich für die Landschaftsfotografie mit Sternenhimmel zu begeistern anfing, wechselte ich von der Nikon D90 auf die D700. Und das auch mit gutem Grund: In der „Astrofotografie“ steht so wenig Licht zur Verfügung, dass man um jede zusätzliche Blendenstufe kämpfen muss.

Mit meiner damaligen Ausrüstung, einer Nikon D90 mit Tokina 12-24mm f/4.0, kam ich nie auf qualitativ überzeugende Bilder. Ich war ständig am Anschlag mit Blende, Belichtungszeit und ISO.

Als Nikon das neue 24mm f/1.4 ankündigte, habe ich meine gesamte Kameraausrüstung sofort verkauft und mir eine D700 mit dem 24mm geholt. Das war einige Zeit lang mein einziges Objektiv.

Durch den grösseren Bildkreis und die viel höhere Lichtstärke konnte ich mit der neuen Kombination ziemlich genau 20x mehr Licht einsammeln als zuvor. Wo ich zuvor 10 Minuten hätte belichten müssen, konnte ich nun den Verschluss nach 30s wieder schliessen.

Die D700 mit dem 24er und einem stabilen Carbonstativ, das sind die essentiellen Zutaten für mein Nebelmeerbild.

– Kameraeinstellungen

Die richtigen Kameraeinstellungen habe ich mittlerweile im Blut: Blende ganz auf, Verschlusszeit bei 24mm Brennweite auf 25s festlegen – um Strichspuren bei den Sternen zu vermeiden – und mit der ISO dann die Belichtung steuern.

Das Fokussieren geht mittlerweile auch schnell von der Hand: LiveView einschalten, Objektiv auf MF stellen und in der höchsten LiveView-Zoomstufe manuell auf einen hellen Lichtpunkt fokussieren. Dann noch den Ausschnitt passend wählen und den Horizont über die eingebaute Wasserwaage geraderücken. Fertig.

Am Schluss steht die ISO lediglich noch auf 200, weil das leuchtende Nebelmeer doch vergleichsweise hell leuchtet.

– Belichtung

Über einen Timer gebe ich nun die benötigten Bilder in Auftrag. Hier will ich insgesamt rund 400s belichten. Eine kurze Pause im Schnee bietet sich an, während die Kamera an die Arbeit geht. Auf Dunkelbildabzüge verzichte ich generell, da dies entweder meine Wartezeit verlängert – und damit die Anzahl möglicher Bilder pro Ausflug halbiert -, oder aber eine Blendenstufe an Licht verschwendet. Die allfälligen Hotpixel müssen dann halt von Hand entfernt werden. Mein Ausgangsbild sieht nun so aus:

Bis ich von diesem düsteren Rohbild das gewünschte Ergebnis bekomme, gibt es noch einiges zu tun:

Bearbeitung

– neoHDR

Das Problem mit dem Rohbild ist nun, dass ich selbst mit meiner Ausrüstung nicht genügend Licht für die dunkleren Bereiche im Bild auf den Sensor bannen kann. Wenn ich die Schatten hochziehen will, rauscht es ziemlich arg. Das kann ich zwar wieder entrauschen, aber für einen grossformatigen und detaillierten Ausdruck reicht die Qualität einfach nicht.

Der einzige gangbare Weg führt über eine längere Belichtungszeit. Das aber wiederum führt zu Strichspuren – ein Dilemma! Ein gutes Jahr ist es her, als ich mich nicht mehr mit diesem Zustand abfinden wollte.

Als Software-Entwickler entwarf ich darum eine Software, welche die Sternenbewegung zurückrechnet und mir automatisch ein „korrigiertes“ Endresultat liefert – und das sogar noch als HDR. Das Prinzip funktionierte so gut, dass ich mich mittlerweile vor Anfragen zu meinem Programm kaum mehr retten kann.

Dabei war die Software von Anfang an nicht dazu geplant, veröffentlicht zu werden; weshalb ich sie zur Zeit auch nicht so schnell und einfach auf den Markt bringen kann, wie viele sich das wohl wünschen würden. Nach wie vor gibt es keine Pläne meinerseits für eine Veröffentlichung. In diversen Foren und Webseiten läuft das Tool unter dem von mir eingeführten Namen „neoHDR“. Für ganz verzweifelte Seelen plane ich, die Korrektur vorderhand als Dienstleistung anzubieten.

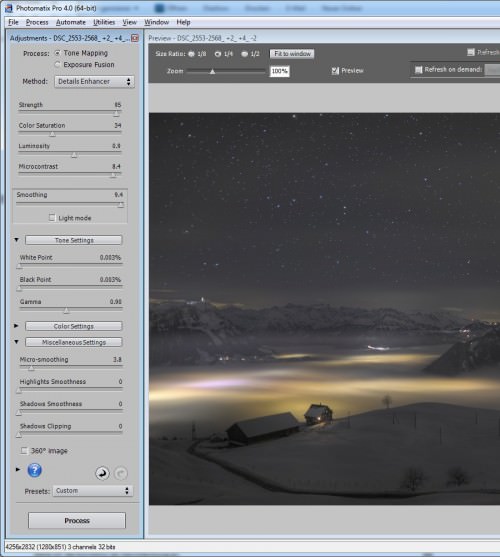

– HDR

Da neoHDR eigentlich nur ein HDR-Aufbereitungstool ist, muss ich das Tone Mapping nach wie vor mit einem der gängigen Tools machen. Ich nutze schon seit jeher Photomatix und war immer sehr zufrieden damit. Die Einstellungen variieren zwar etwas von Bild zu Bild, aber meistens sehen sie etwa so aus:

Das Ergebnis darf hier ruhig etwas unspektakulär und flau aussehen. Photomatix ist für mich nur ein Durchlauferhitzer. Das Finetuning mache ich ein einem konventionellen Bildbearbeitungsprogramm:

Abschlussarbeiten

Die getonemappten HDRs aus Photomatix haben fast immer die gleichen Mängel, so dass die nachträglichen Optimierungen meistens sehr speditiv von der Hand gehen. Auch hier musste ich an den gewohnten Reglern drehen um das gewünschte Ergebnis zu bekommen. Eine Sache von wenigen Minuten.

In Lightroom als 16bit-TIFF importiert, habe ich dann folgende Anpassungen vorgenommen:

Und fertig ist das detailreiche Nebelmeerfoto.

- Planungsaufwand: insgesamt etwa 4-5 Stunden.

- Ausflugsdauer: 6 Stunden.

- Bearbeitungsaufwand: 15 Minuten.

Weitere Nebelmeere

Anbei noch eine kleine Auswahl anderer Nebelmeere, wie ich sie auf meinen nächtlichen Ausflügen angetroffen habe: