KI in der Werbung – was geht und was (noch?) nicht geht.

Künstliche Intelligenz hält immer größeren Einzug in die Werbebranche. Als Kommunikationsexperte berate ich große Firmen im Bereich Onlinemarketing und Media gemeinsam mit meinem Kollegen Stefan Filtgen. Er hat sich in die Welt der KI eingearbeitet und mit mir in diesem Interview seine Erkenntnisse nach den ersten 841 Midjourney-Bildern geteilt.

Unsere Branche streitet über bildgenerierende KI – ist das denn wirklich das nächste große Ding?

So wie wir das mit ChatGTP erlebt haben, hat auch die bildgenerierende KI, wie Midjourney oder Stable Diffusion, in den letzten Monaten unglaubliche Sprünge gemacht. Seit ein paar Jahren kennen wir Programme und Apps, die ein Selfie in einen Comic-Avatar oder einen Elfen verwandeln, aber für ein professionelles Bild haben KIs einfach noch zu viele Fehler gemacht. Da stimmten die Proportionen und Größenverhältnisse nur selten und komplexe Strukturen wie Gesichter oder Haare wirkten eher gezeichnet als fotografiert.

Das hat sich geändert?

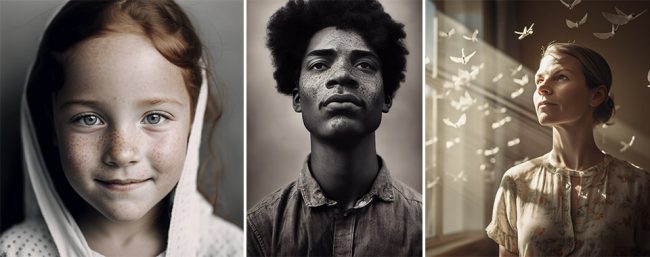

Definitiv. Wenn es gut gemacht ist, kann man Portraits aus einer KI nur noch schwer von echter Fotografie unterscheiden. Es gibt auch tatsächlich Beispiele, in denen Fotograf*innen für ihre sensationellen Portraits gelobt werden und dann stellt sich heraus, dass sie dafür keine Kamera in der Hand haten. Ärgerlich daran ist für mich nur die Behauptung, die Bilder seien wirklich fotografiert, im Beispiel beschreibt ein Instagram-Fotograf sogar seine Ausrüstung („a Nikon D810 with 24–70 mm lens“). Gute Bilder können es natürlich immer trotzdem sein.

Kann ein KI-Bild denn ähnlich realistisch, ich möchte fast fragen „authentisch“ wirken, wie ein Foto?

Es gibt ganze Branchen, in denen die Fotografie und ebenso die Darstellung von Menschen zunehmend artifiziell geworden sind. Zum Beispiel sehen wir in der Modefotografie oft Bilder, die kein echter Mensch so erreichen kann. Das beginnt bei der Anatomie der Modelle, geht über die Inszenierung und die sehr aufwändige Retusche von Haut und Gesichtsformen.

Hier fließen zwei Entwicklungen gegeneinander: Fotografie wird immer künstlicher und das Künstliche immer echter. Ich kann mir gut vorstellen, dass wir bald einen Gegentrend erleben und das Echte und Ungeschönte wieder Einzug in die Fotografie von Fashion und Beauty halten werden. Wenn sich TikToker*innen mit Filtern wie „bold glamour“ selbst optimieren, werden wir das nicht durchoptimierte Bild hoffentlich wieder schätzen.

Wie einfach oder schnell ist denn ein KI-Bild erzeugt?

Das erste KI-Bild erzeugt man in ein paar Minuten. Einfach eine textliche Beschreibung des gewünschten Bildes bei Stable Diffusion oder DALL·E eingeben, dem Algorithmus 15 bis 20 Sekunden geben und schon bietet er vier Bilder an, die mehr oder weniger mit der Aufgabe zu tun haben. Die echte Bildkreation beginnt danach. Dabei arbeitet man die sogenannten „Prompts“ immer genauer, feiner aus und referenziert alles, was bereits entstanden ist.

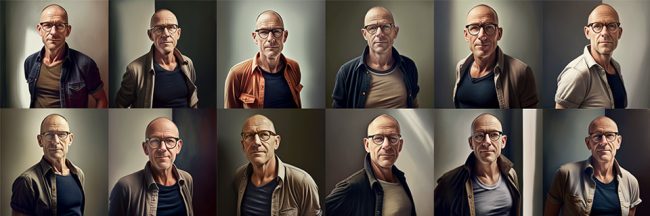

Bis man mit dem Ergebnis zufrieden ist, können Dutzende Zwischenbilder entstehen. Darin liegt das Potenzial, aber auch eine ganze Menge kreativer Arbeitszeit. Wenn ich zum Beispiel ein Bild von mir hochlade und dem Algorithmus beschreibe, was er tun soll, dann bekomme ich erst einmal eine große Auswahl von Bildern, die teilweise schon gut aussehen, aber nicht das sind, was ich mir vorgestellt habe.

In diesem Beispiel sehen alle Bilder meinem Ausgangsmotiv ähnlich, aber sie sehen nicht mehr wie Fotos aus, eher wie gute Karikaturen. Das ist der Standard auf Midjourney, aber da geht mehr. Also muss sich genauer beschreiben, was ich möchte, bis ich schließlich etwa bei diesem Bild lande:

Um das Ergebnis zu erzielen, bin ich – ähnlich wie nach einer Fotosession – noch durch einen Entwicklungsprozess in Capture One und kleinere Korrekturen in Photoshop gegangen, bis ich tatsächlich zufrieden war.

Kann ich denn mit der KI auch in ein „kreatives Sparring“ gehen und mich inspirieren lassen?

Unbedingt. Für mich könnte das eine der zentralen Einsatzmöglichkeiten im Rahmen einer Kampagnen- oder Bildkreation sein. Ich kann die KI zum Beispiel bitten, mehrere Motive miteinander zu kombinieren, die Ergebnisse sind richtig interessant. Ich scheue mich fast den Begriff zu benutzen, aber ja: Sie sind auch höchst „kreativ“.

Wo siehst Du Grenzen?

Hände und „Konkretes“. Die KI mischt alles, was sie hat, bei Gesichtern werden das gemischte Gesichter, aber bei Händen werden das heute noch Objekte mit drei oder sechs Fingern, die nur in der Haltung an eine Hand erinnern, allerdings tut sich gerade an diesem Punkt zur Zeit sehr viel.

Konkretes, also ein bestimmter Mensch, ein bestimmtes Produkt oder auf Textebene, eine ganz konkrete Aussage, werden wir noch lange nicht von einem Algorithmus bekommen. Das Konkrete widerspricht seiner Konstruktion, ein Ergebnis aus möglichst vielen Quellen möglichst generell zu modellieren. Wenn das nicht gelingt, spricht die Branche auch von „halluzinieren“.

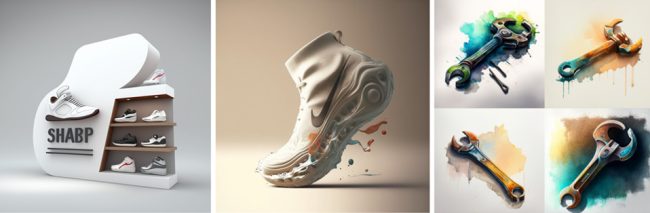

In Kombination mit echten Bildern sehe ich allerdings kaum Grenzen. Wenn wir beispielsweise einen realen Produktschuss anbieten und diesen per Algorithmus in ein Bild platzieren, können wir mit den Werkzeugen in Zukunft fast alles bauen.

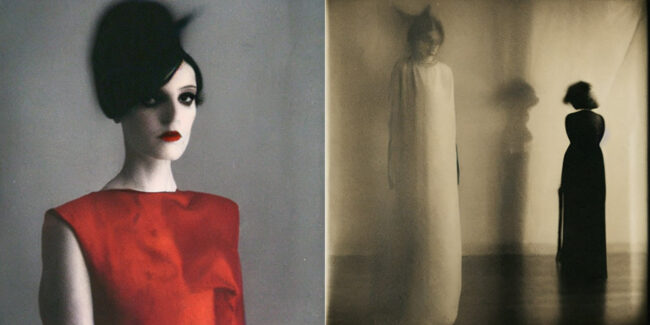

Ich möchte das mit einer Bildstrecke illustrieren, die nicht von mir ist. Die Künstlerin Bonnie Tsang beschreibt sich auf Instagram selbst als „Photographer experimenting with AI“ und zeigt, wie die Werkstatt einer Bild-KI aussehen könnte. Es gibt einen Eindruck davon, was für uns als visuelle Geschichtenerzähler*innen alles möglich sein wird.

Du sprachst vorhin schon von Karikatur. Wie gut werden denn Illustrationen mit Hilfe von künstlicher Intelligenz?

Ich sehe tatsächlich die Illustration noch deutlich vor der Fotografie, wenn man so will, „bedroht“. Sobald die Abbildungen etwas freier sein dürfen und keinen fotorealistischen Anspruch mehr haben, ist das Ergebnis sehr gut und professionell anwendbar. Illustration in der Werbung war immer ein sehr abstimmungsintensives Produkt. Das wird KI deutlich beschleunigen und damit auch günstiger machen.

Ich denke aber, dass wir Illustrator*innen weiter benötigen. Um diese Bilder zu schaffen, braucht man Vorstellungskraft, muss das Ergebnis kennen, bevor man es sieht und es hilft, sich gut mit Zeichentechniken auszukennen. Vielleicht erleben wir dadurch sogar ein Revival illustrierter Kampagnen, so wie es sie bis in die 60er Jahre hinein gab. Das fände ich großartig!

Gibt es denn schon Beispiele für Kampagnen, die KI sinnvoll einsetzen, also nicht nur um zu sagen, seht her, wir haben eine KI-Kampagne?

Ja, die Antwort lautet: Mit Ketchup und Wein. Oder ausführlicher: Sehr schnell bekannt geworden ist die Kampagne „The Fine Art of Drinking“ des Weinguts Al Mulineto. Dabei sehen wir, was Illustration richtig angewendet leisten kann. Auch der Heinz-Ketchup-Spot ist aus meiner Sicht sehr gelungen. Die Idee, eine KI nach Ketchup zu fragen und sie zeichnet einem immer eine Heinz-Flasche, dieser Ansatz greift das Thema superkreativ auf. Das dürfte aber in einem halben Jahr nicht mehr funktionieren, weil wir uns dann wohl an den Einsatz von KI gewöhnt haben. Heute schreibt ja auch kein Mensch mehr „ohne Photoshop“ oder „digital fotografiert“ zu einem Bild.

Auch im redaktionellen Einsatz habe ich ein gutes Beispiel gesehen. Der Stern hat seine Strecke über künstliche Intelligenz mit KI-Illustrationen bebildert, die sehr gut funktioniert haben.

Hast Du KI auch schon in Deiner eigenen professionellen Fotografie genutzt?

Die Antwort ist ein Jein. Als Fotograf bin ich in der Portrait- und People-Fotografie angesiedelt. Solange ich einen ganz bestimmten Menschen abbilden möchte, macht der Einsatz von KI für mich überhaupt keinen Sinn. Ganz ehrlich: Der ganze Prozess, das gemeinsame Erarbeiten des richtigen Moments ist ja ein wichtiger Faktor für ein gutes Bild. Vielleicht sogar der wichtigste!

Die Portraits, die oben zu sehen sind, sind ein Ausprobieren, wie nah man an das „Echte“ herankommt. Anders sehe ich das im Bereich Illustration. Dort haben wir in der Agentur schon einige Bilder für Kund*innen erzeugt. Darunter eine 3D-Präsentation für Schuhe und Werkzeugillustrationen. Aktuell arbeiten wir an einer Kampagne für einen Software-Anbieter, in der KI-Illustration eine zentrale Rolle spielen wird.

Wem gehört das Werk eigentlich? Wie sieht es mit den Bildrechten aus?

Leider ein bisher unklares Thema. Das US-amerikanische Urheberrechtsamt hat kürzlich in einer Eilentscheidung entschieden, dass die Werke vorerst überhaupt nicht dem Urheberrecht unterliegen. Es haben also weder die Menschen, die mittels KI ein neues Bild erschaffen, noch die Inhaber*innen der KI und auch nicht die Rechteinhaber der Bilder, mit denen die KI trainiert wurde, ein Urheberrecht an den entstandenen Werken. Aber es laufen eine Reihe von Grundsatzklagen, um darüber Rechtssicherheit zu schaffen, unter anderem Getty Images gegen Stable Diffusion.

Solange wir an diesem Punkt keine Entscheidungen haben, befinden wir uns tatsächlich in einem ungeklärten Raum. Erste Ansätze, die Ergebnisse lizenzierbar zu machen, gibt es. Zum Beispiel bietet Shutterstock einen eigenen Zugriff auf Stable Diffusion und verspricht, das Ergebnis zusammen mit geklärten Rechten verkaufen zu können. Ich denke, da wird sich noch einiges zurechtruckeln müssen. Für sehr vorsichtige Agenturen und Kund*innen ist es also wahrscheinlich noch der falsche Moment, um komplett auf KI zu setzen.

Vielen Dank für das interessante Gespräch, Stefan.

Danke auch von mir und dazu ein letztes Motiv: unser Agenturlogo, interpretiert von einer KI. Der Prompt lautete: For-Sale-Männchen und „a small cartoon character is shouting in a giant megaphone, stylize, cinematic, white background“.